El uso de deepfakes, una técnica de inteligencia artificial que permite crear vídeos falsos de personas que aparentemente son reales, utilizando para ello algoritmos de aprendizaje no supervisados, van poco a poco constituyéndose en otra de las amenazas que afectan a la información en internet. Ya se han dado casos de deepfakes que falsean vídeos de personas conocidas y se han dado por buenos, generando notables perjuicios al afectado y a las audiencias, en general.

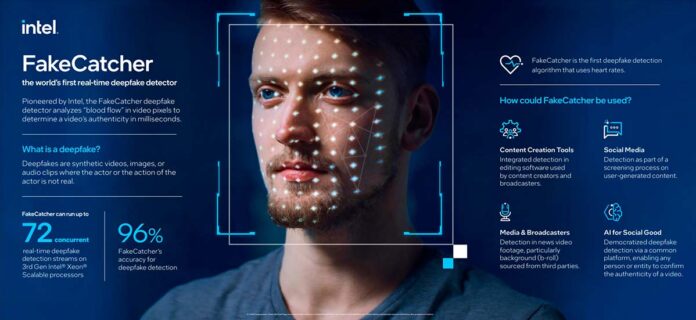

Intel ha desarrollado un detector de deepfakes que, asegura la empresa de tecnología, tiene una precisión del 96%.

Según Ilke Demir, científica sénior de investigación de Intel, la plataforma de detección de deepfakes de Intel, que utiliza la tecnología FakeCatcher, identifica estas falsificaciones con altos niveles de precisión en tiempo real, basándose en la fotopletismografía.

La fotopletismografía o fotopletismograma es una técnica de pletismografía en la cual se utiliza un haz de luz para determinar el volumen de algún órgano, en este caso, el flujo de sangre que recorre la superficie de la piel. La tecnología se ha adaptado para poder ser usada de manera análoga en la detección de estas falsificaciones.

Además de FakeCatcher para encontrar señales biológicas, el algoritmo también observa varias características prominentes de los ojos y la mirada que los deepfakes exhiben de manera diferente a los originales.